在 2026 年,个人开发者与初创团队在 AI 领域的竞争,本质上是“算力利用率”与“网络渗透率”的竞争。随着模型规模的持续膨胀,如何绕过地缘 API 封锁、降低跨境数据传输的高昂延迟、并构建一套能够自动感知网络状态的分布式集群,已成为 AI 部署的核心课题。

本文将深入探讨利用高质量住宅网络链路(Residential Network Infrastructure)构建下一代 AI 分布式推理网络的底层逻辑与实战细节。

一、 地缘风控与 IP 权重的深层博弈

进入 2026 年,主流 AI 厂商(如 OpenAI、Anthropic 及各地区的本地推理中心)对 IP 来源的检测已从“名单比对”进化为“多维指纹画像”。

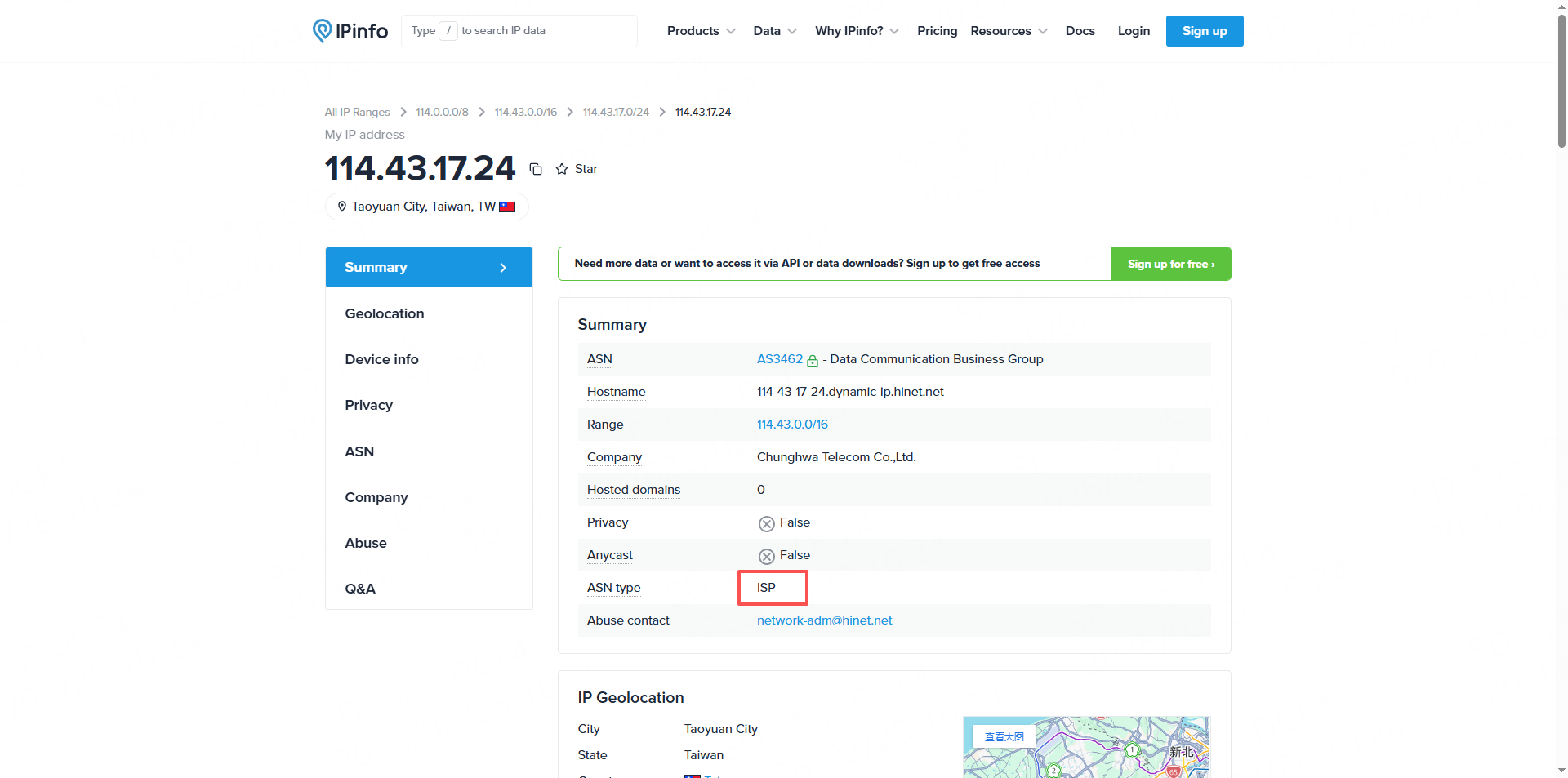

- ASN 权重隔离: 平台通过识别请求来源的 ASN(自治系统编号),能瞬间区分该请求来自阿里云机房还是美区的一家普通宽带商。机房 IP 段在 AI 接口调用中常被默认打上“自动化低质量请求”的标签。

- 物理位置对齐: 在分布式场景中,如果你的 API Key 注册地为美区,但访问请求的网段长期漂移且无固定住宅 ISP 属性,账号极易触发风险审核。

- 信誉度积累: 长期使用固定的住宅链路进行请求,可以像养号一样积累 IP 的“信誉分”,从而获得更高的 API 调用并发上限(Rate Limits)。

二、 静态 ISP 与动态住宅在 AI 场景下的效能差异

在架构设计之初,开发者必须明确两种资源的底层差异:

-

静态 ISP 住宅: 具有固定不动的 IP 地址,且 ASN 属性为真实网络服务提供商。它是 “AI 账号权重维护” 和 “长连接 WebSocket 保持” 的核心资源。

-

动态住宅: IP 随任务轮换。它更适合 “大规模分布式数据抓取” 和 “对抗单一 IP 频率限制” 的临时任务。

对于需要高可靠性的分布式部署,静态 ISP 是 2026 年公认的工业级标准,其网络丢包率比动态池低约 40%-60%。

三、 【核心扩充板块】全球分布式架构的逻辑层深度设计

这一板块是整套系统的“大脑”。在分布式部署中,网络链路不仅是通道,更是智能调度的依据。

1. 边缘网关的“协议透明化”设计

在 2026 年,AI 部署的难点在于如何处理 HTTP/3 与 QUIC 协议。开发者应在每个住宅节点的前端部署一个轻量级的边缘网关(Edge Gateway)。该网关的作用是将 AI 模型产生的海量流式数据(Stream Data)进行本地化封装。

- 0-RTT 连接: 利用住宅链路对 QUIC 协议的支持,实现 0-RTT(零往返延迟)重新连接,这能让 AI 对话的响应首字延迟缩短 100-200 毫秒。

- Header 指纹伪装: 网关会自动提取目标 API 所需的特定 TLS 头部指纹(如 JA4),并将其与住宅 IP 的系统特征进行实时匹配。

2. 智能地理围栏调度算法(Geo-Aware Scheduling)

分布式架构不应是盲目的负载均衡,而应具备“地缘感知力”。

- 节点分层: 建立三层节点体系:核心节点(靠近算力源)、中转节点(解决跨海光缆拥塞)、终端节点(部署在住宅网路中,直接对接 API 服务)。

- 动态 RTT 评分机制: 调度系统每分钟向全球住宅节点发送探测包。根据返回的 TTFB(首字节时间) 和 丢包梯度,动态调整权重。例如,当美东海底光缆发生物理故障时,算法会自动将流量经由欧区住宅节点中转。

3. Session 持久化与连接池复用

AI 推理通常涉及长对话。开发者必须在分布式链路中实现 “粘性 Session(Sticky Sessions)”。

- IP 锁定: 确保同一对话(Conversation ID)的所有请求始终映射到同一个住宅 ISP 节点。

- 预连接技术: 预测用户可能的输入,预先建立与住宅节点的连接池,减少握手开销。

四、 【核心扩充板块】高阶性能调优与故障自愈机制

为了支撑千万级的 AI 调用,单靠几个 IP 是不够的,必须建立自动化运维体系。

1. UDP 数据包的优化策略

由于 AI 语音(Voice AI)和实时视频生成的爆发,UDP 转发已成为刚需。

- MTU(最大传输单元)自适应: 住宅宽带的 MTU 通常与机房不同。开发者应通过代码实现路径 MTU 发现(PMTUD),避免因数据包过大导致的拆包和丢包,这能提升 20% 的音视频传输质量。

- 前向纠错码(FEC): 在极不稳定的住宅链路段应用 FEC 技术,通过增加少量冗余数据来修复丢包,避免因网络抖动导致的 AI 推理重连。

2. 失效自愈:基于“存活探针”的节点平滑迁移

在分布式环境中,住宅节点可能因为拨号重连或 ISP 维护而暂时掉线。

- 多副本机制: 为每一个高价值 AI 环境准备 1 主 2 备的静态节点。

- 无感知切换(Zero-Downtime Migration): 当监控探针发现主节点延迟异常升高时,调度层会在 TCP 握手间隙将后续请求镜像到备份节点。利用代理层的“会话无感保持”技术,用户端完全感受不到网络切换。

3. 流量混淆与 TLS 特征对齐

为了防止 AI 流量被特定地区的 ISP 识别并限速(Throttling),开发者应在住宅链路上应用 “特征对齐” 技术。

- 模仿主流流量: 将 AI 推理的 JSON 数据包特征伪装成普通的网页交互或静态资源请求,通过修改 TLS 的 Server Name Indication (SNI) 绕过深度包检测(DPI)。

五、 自动化监控实战:利用 Python 构建流量质量矩阵

开发者需要一套量化的工具来评估各节点的表现。

import httpx

import time

import statistics

def benchmark_residential_node(node_url, target_api):

"""

对住宅节点进行高阶性能评测

"""

latencies = []

success_count = 0

for i in range(10): # 连续 10 次压力测试

start_time = time.perf_counter()

try:

with httpx.Client(proxies={"https://": node_url}, timeout=15) as client:

resp = client.post(target_api, json={"prompt": "Ping"})

if resp.status_code == 200:

latencies.append(time.perf_counter() - start_time)

success_count += 1

except Exception:

continue

if latencies:

avg_lat = statistics.mean(latencies)

jitter = statistics.stdev(latencies) if len(latencies) > 1 else 0

print(f"节点报告: 成功率 {success_count*10}% | 平均延迟 {avg_lat:.3f}s | 抖动 {jitter:.3f}s")

else:

print(" 节点不可用")

# 模拟检测一个全球节点的健康状况

# benchmark_residential_node("socks5://user:pass@global-isp:port", "https://api.ai.com/v1")

六、 针对不同 AI 平台的“环境对齐”方案建议

- 文本推理(LLMs): 侧重 IP 的 地理对齐 和 Session 稳定性。

- 多模态生成(Image/Video): 侧重 带宽吞吐量。建议使用具备万兆出口的静态住宅链路,减少大文件回传时长。

- 语音交互(Voice/Real-time): 侧重 UDP 性能 和 延迟抖动控制。节点物理位置必须尽可能靠近目标数据中心。

七、 2026 安全合规:AI 数据流的隐私屏障

分布式架构在带来便利的同时,也增加了攻击面。

- 端到端加密: 确保边缘节点仅转发加密包,不具备任何密钥读取能力。

- 访问控制(ACL): 在静态 ISP 节点层级设置 IP 白名单,仅允许你的分布式算力服务器访问,防止代理资源被盗用。

- 离线审计: 定期离线分析节点流量日志,识别是否存在异常的探测行为。

八、 总结:2026 AI 基础设施的底层逻辑

在 2026 年,一个成功的 AI 项目背后,必然有一套极其强韧的网络架构。

- 认清技术本质: 住宅网络链路不仅是访问工具,它是 AI 全球化部署的 “流量中枢”。

- 投资高质量资源: 避开那些低端、不稳定的资源。在高价值 AI 业务中,稳定性的价值远超其溢价。

- 构建自研体系: 利用 Python 和边缘计算工具,将零散的住宅资源整合为一套具备自愈能力的分布式云网络。